在 MapReduce 的 数据序列化类型 中,介绍了几种常见的 Hadoop 序列化类,实现了一个基础的 WordCount Demo,使用到了 Long、String、Integer 对应的序列化类,那么接下来就需要了解一下 Hadoop 具体的怎么序列化的。

Hadoop 序列化

序列化概述

什么是序列化、反序列化

序列化:就是把内存中的对象,转换为字节序列 或其他数据传输协议,以便存储到磁盘或网络传输。

反序列化:就是将收到的字节序列或其他数据传输协议或磁盘的持久化数据,转换成内存中的对象。

为什么要序列化?

一般来说,对象 只能生存在内存中,断电即消失。而且,对象 只能由本地进程使用,不能被发送到网络上的另外一台计算机中。

然而,序列化 可以存储 对象,且可以将对象 发送到远程计算机。

为什么不用 Java 自身的序列化?

Java 的序列化是一个重量级的框架(Serializable),一个对象被序列化后,别额外附带很多信息,如:校验信息、Header、继承体系等,不便于在网络中高效传输。基于此,Hadoop 开发了一套属于自己的序列化机制:Writable。

Hadoop 序列化的特点

- 紧凑:高效使用存储空间

- 快速:读写数据的额外开销小

- 可扩展:随着通信协议的升级而升级

- 互操作:支持多语言交互

自定义实现序列化

实现步骤:

- 实现 Writable 接口

- 反序列化时,需要反射调用空参构造函数

- 重写序列化方法

- 重写反序列化 方法

- 反序列化的顺序和序列化的顺序保持一致

- 重写 toString

- 实现 Comparable 接口(MapReduce 的 Shuffle 过程要求对 key 必须能排序;当需要排序的时候才做)

序列化 Demo

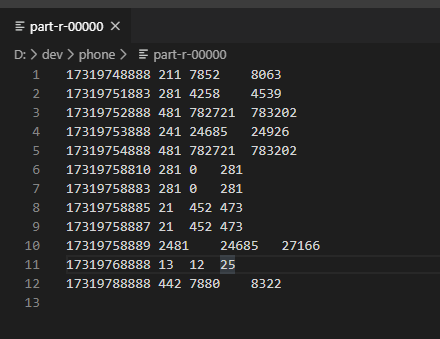

需求:根据 测试文件,统计每个手机号的上行流量、下行流量、总流量。

文件中,倒数第三列为上行流量,倒数第二列为下行流量,最后一列为网络请求状态码。

创建统计流量的 Bean 对象

创建一个统计流量的 Bean 对象,并实现序列化操作

1 | public class FlowBean implements Writable { |

MapReduce 程序

Mapper

1 | public class FlowCountMapper extends Mapper<LongWritable, Text, Text, FlowBean> { |

Reducer

1 | public class FlowCountReducer extends Reducer<Text, FlowBean, Text, FlowBean> { |

Deiver

1 | public static void main(String[] args) throws IOException, ClassNotFoundException, InterruptedException { |

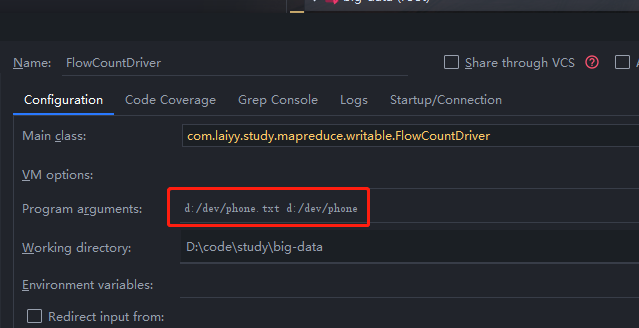

运行测试

设置输入输出路径:

查看输出结果: